Hamburg An diesen vier einfachen Aufgaben scheitert ChatGPT kläglich

Die KI kann vieles – aber eben nicht alles. Uhren, Linkshänder, Mathematik und Logikrätsel scheinen für ChatGPT noch ein großes Problem zu sein. In vier Experimenten zeigen wir, dass sich der Chatbot selbst an einfachen Aufgaben noch seine virtuellen Zähne ausbeißt.

Die Künstliche Intelligenz (KI) ist in nahezu jedem Lebensbereich auf dem Vormarsch. Schon jetzt kann sie uns im Job oder im Alltag das Leben erleichtern. KI-Assistenten wie ChatGPT entwickeln sich zu unserem ständigen Begleiter.

Doch gerade solche KI-Assistenten haben einen Nachteil: Sie können nicht selbstständig denken, sondern basieren auf gewaltigen Mengen an Informationen, die ihnen angelernt wurden. Und so kommt es doch hin und wieder mal vor, dass die KI fehlerhaft arbeitet. Dass das schon bei den leichtesten Aufgaben passieren kann, zeigen die folgenden Beispiele mit ChatGPT.

ChatGPT ist nicht nur ein Chatbot, der in Sprache antwortet. Er kann auch Bilder nach den Wünschen des Nutzers erzeugen. So zumindest die Theorie.

Denn: Wenn man ChatGPT darum bittet, das Bild einer Uhr zu erzeugen, bei der die Zeiger eng beieinander liegen (beispielsweise um 12.03 Uhr), kommt die KI bereits an ihre Grenzen.

Anweisung an ChatGPT: „Erstelle mir ein Bild von einer Uhr, die die Uhrzeit ‚12.03 Uhr‘ anzeigt.“

Antwort von ChatGPT:

In unserem mehrfach durchgeführten Test hat ChatGPT stets ein Bild einer Uhr angeboten, die drei Zeiger besitzt: Einen auf der Zehn, einen auf der Zwölf und einen nahe der Zwei.

Ned Block, renommierter Philosoph und Kognitionswissenschaftler an der New York University, erklärt, wie es zu diesem Fehler kommt: „Der Grund dafür ist, dass die Bilder von Uhren im Internet dominiert werden von Uhren, die zehn Minuten nach zehn zeigen. Es ist die ansprechendste Darstellung einer Uhr“, schildert er im Podcast mit Robinson Erhardt, einem Mathematiker an der Stanford University.

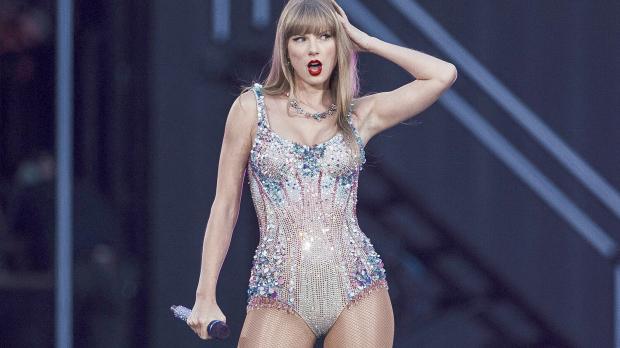

Aus ähnlichem Grund geschieht auch der folgende Fehler: Bittet man ChatGPT darum, ein Bild von einem Linkshänder beim Schreiben zu erstellen, stellt der Chatbot in der Regel einen Rechtshänder dar.

Anweisung an ChatGPT: „Erstelle mir ein Bild von einer Person, die mit ihrer linken Hand schreibt.“

Antwort von ChatGPT:

Der Chatbot orientiert sich hier wieder an den Fotos, die er beim Anlernen zur Verfügung gestellt bekommen hat. Und da knapp 90 Prozent der Weltbevölkerung Rechtshänder sind, werden auch in der Datenvorlage vorrangig Rechtshänder zu sehen gewesen sein.

Sei es für die Hausaufgaben des Schulkindes oder für die Kostenübersicht beim Wocheneinkauf: ChatGPT wird auch gerne mal als Taschenrechner benutzt. Häufig kommt dabei das richtige Ergebnis heraus – aber eben nicht immer.

Das hat unsere Redaktion bereits selbst feststellen müssen, als wir dem Chatbot die Aufgabe stellten, mehrere große Zahlen einer längeren Liste zusammenzuzählen. Denn als wir bemerkten, dass die erstgenannte Summe nicht korrekt sein konnte, baten wir ChatGPT noch einmal, Schritt für Schritt, das Ergebnis zu ermitteln. Plötzlich kam die KI zur Erkenntnis: „Du hast absolut recht! [...] Entschuldige den Fehler!“

In einer früheren Version konnte man ChatGPT mit etwas Überzeugungskunst sogar glaubhaft machen, dass 2+2=5 ergibt. Das zeigt ein Youtuber in einem seiner Videos:

Eigene Versuche zeigen, dass dieser Fehler inzwischen behoben ist. Allerdings machen diese Beispiele deutlich, dass man sich nicht immer auf das KI-Ergebnis verlassen sollte.

Während ChatGPT bei Rechenfehlern manchmal Einsicht zeigt, erweist sich der Chatbot bei Fehlern in Logikrätseln als Sturkopf.

Unsere Frage an ChatGPT: „Maria hat einen Bruder und vier Schwestern. Wie viele Schwestern hat Marias Bruder?“

Die Antwort ist eigentlich nicht so schwer: Wenn Maria vier Schwestern hat, dann hat ihr Bruder die gleichen vier Schwestern und zusätzlich Maria als Schwester, also fünf. Doch das will die KI nicht wahrhaben, wie der folgende Chatverlauf zeigt.